这一章跟着paddle的官方教程来手写数据处理部分。

首先导入相关库

# 加载飞桨和相关数据处理的库

import paddle

import paddle.fluid as fluid

from paddle.fluid.dygraph.nn import Linear

import numpy as np

import os

import gzip

import json

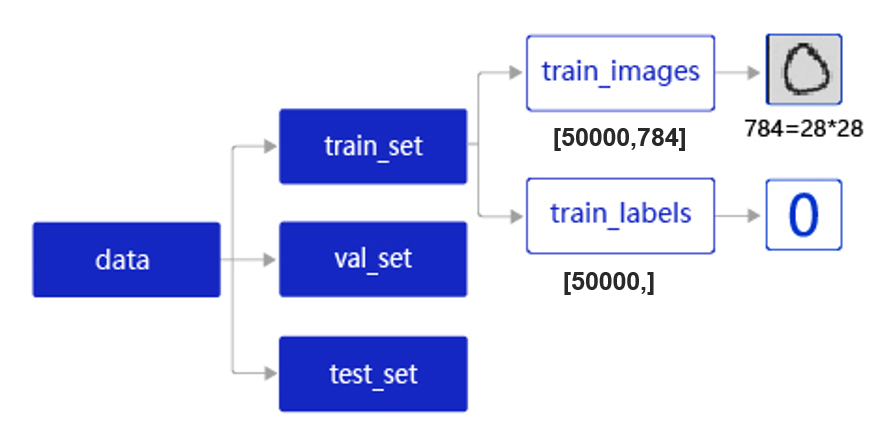

import random首先查看mnist数据的存储形式,这里给的数据是json格式,直接用json库打开得到一个list,结构如图

# 声明数据集文件位置

datafile = './work/mnist.json.gz'

print('loading mnist dataset from {} ......'.format(datafile))

# 加载json数据文件

data = json.load(gzip.open(datafile))

print('mnist dataset load done')

# 读取到的数据区分训练集,验证集,测试集

train_set, val_set, eval_set = data

# 数据集相关参数,图片高度IMG_ROWS, 图片宽度IMG_COLS

IMG_ROWS = 28

IMG_COLS = 28

# 打印数据信息

imgs, labels = train_set[0], train_set[1]

print("训练数据集数量: ", len(imgs))

# 观察验证集数量

imgs, labels = val_set[0], val_set[1]

print("验证数据集数量: ", len(imgs))

# 观察测试集数量

imgs, labels = val= eval_set[0], eval_set[1]

print("测试数据集数量: ", len(imgs))下面来实现返回一批次的数据的数据生成器,这里用到了迭代器,也就是yield。 这个博主讲的比较简单易懂https://blog.csdn.net/mieleizhi0522/article/details/82142856/ 那么就来写我们自己的数据迭代器

imgs, labels = train_set[0], train_set[1]

print("训练数据集数量: ", len(imgs))

# 获得数据集长度

imgs_length = len(imgs)

# 定义数据集每个数据的序号,根据序号读取数据

index_list = list(range(imgs_length))

# 读入数据时用到的批次大小

BATCHSIZE = 100

# 随机打乱训练数据的索引序号

random.shuffle(index_list)

# 定义数据生成器,返回批次数据

def data_generator():

imgs_list = []

labels_list = []

for i in index_list:

# 将数据处理成期望的格式,比如类型为float32,shape为[1, 28, 28]

img = np.reshape(imgs[i], [1, IMG_ROWS, IMG_COLS]).astype('float32')

label = np.reshape(labels[i], [1]).astype('float32')

imgs_list.append(img)

labels_list.append(label)

if len(imgs_list) == BATCHSIZE:

# 获得一个batchsize的数据,并返回

yield np.array(imgs_list), np.array(labels_list)

# 清空数据读取列表

imgs_list = []

labels_list = []

# 如果剩余数据的数目小于BATCHSIZE,

# 则剩余数据一起构成一个大小为len(imgs_list)的mini-batch

if len(imgs_list) > 0:

yield np.array(imgs_list), np.array(labels_list)

return data_generator

# 声明数据读取函数,从训练集中读取数据

train_loader = data_generator

# 以迭代的形式读取数据

for batch_id, data in enumerate(train_loader()):

image_data, label_data = data

# 声明数据读取函数,从训练集中读取数据

train_loader = data_generator

# 以迭代的形式读取数据

for batch_id, data in enumerate(train_loader()):

image_data, label_data = data

if batch_id == 0:

# 打印数据shape和类型

print("打印第一个batch数据的维度,以及数据的类型:")

print("图像维度: {}, 标签维度: {}, 图像数据类型: {}, 标签数据类型: {}".format(image_data.shape, label_data.shape, type(image_data), type(label_data)))

break数据里难免会出现点奇怪的错误,比如之前我就做过一个项目,数据集里有一张图片居然是四通道就会莫名其妙报错,于是需要在加载数据时就写一些检验函数,一般就是检验一下图像的shape和通道数对不对,和便签数量匹不匹配。

imgs_length = len(imgs)

assert len(imgs) == len(labels), \

"length of train_imgs({}) should be the same as train_labels({})".format(len(imgs), len(label))接着把它封装成函数

def load_data(mode='train'):

datafile = './work/mnist.json.gz'

print('loading mnist dataset from {} ......'.format(datafile))

# 加载json数据文件

data = json.load(gzip.open(datafile))

print('mnist dataset load done')

# 读取到的数据区分训练集,验证集,测试集

train_set, val_set, eval_set = data

if mode=='train':

# 获得训练数据集

imgs, labels = train_set[0], train_set[1]

elif mode=='valid':

# 获得验证数据集

imgs, labels = val_set[0], val_set[1]

elif mode=='eval':

# 获得测试数据集

imgs, labels = eval_set[0], eval_set[1]

else:

raise Exception("mode can only be one of ['train', 'valid', 'eval']")

print("训练数据集数量: ", len(imgs))

# 校验数据

imgs_length = len(imgs)

assert len(imgs) == len(labels), \

"length of train_imgs({}) should be the same as train_labels({})".format(len(imgs), len(labels))

# 获得数据集长度

imgs_length = len(imgs)

# 定义数据集每个数据的序号,根据序号读取数据

index_list = list(range(imgs_length))

# 读入数据时用到的批次大小

BATCHSIZE = 100

# 定义数据生成器

def data_generator():

if mode == 'train':

# 训练模式下打乱数据

random.shuffle(index_list)

imgs_list = []

labels_list = []

for i in index_list:

# 将数据处理成希望的格式,比如类型为float32,shape为[1, 28, 28]

img = np.reshape(imgs[i], [1, IMG_ROWS, IMG_COLS]).astype('float32')

label = np.reshape(labels[i], [1]).astype('float32')

imgs_list.append(img)

labels_list.append(label)

if len(imgs_list) == BATCHSIZE:

# 获得一个batchsize的数据,并返回

yield np.array(imgs_list), np.array(labels_list)

# 清空数据读取列表

imgs_list = []

labels_list = []

# 如果剩余数据的数目小于BATCHSIZE,

# 则剩余数据一起构成一个大小为len(imgs_list)的mini-batch

if len(imgs_list) > 0:

yield np.array(imgs_list), np.array(labels_list)

return data_generator下面定义一层神经网络,利用定义好的数据处理函数,完成神经网络的训练。

# 数据处理部分之后的代码,数据读取的部分调用load_data函数

# 定义网络结构,同上一节所使用的网络结构

class MNIST(fluid.dygraph.Layer):

def __init__(self):

super(MNIST, self).__init__()

self.fc = Linear(input_dim=784, output_dim=1, act=None)

def forward(self, inputs):

inputs = fluid.layers.reshape(inputs, (-1, 784))

outputs = self.fc(inputs)

return outputs

# 训练配置,并启动训练过程

with fluid.dygraph.guard():

model = MNIST()

model.train()

#调用加载数据的函数

train_loader = load_data('train')

optimizer = fluid.optimizer.SGDOptimizer(learning_rate=0.001, parameter_list=model.parameters())

EPOCH_NUM = 10

for epoch_id in range(EPOCH_NUM):

for batch_id, data in enumerate(train_loader()):

#准备数据,变得更加简洁

image_data, label_data = data

image = fluid.dygraph.to_variable(image_data)

label = fluid.dygraph.to_variable(label_data)

#前向计算的过程

predict = model(image)

#计算损失,取一个批次样本损失的平均值

loss = fluid.layers.square_error_cost(predict, label)

avg_loss = fluid.layers.mean(loss)

#每训练了200批次的数据,打印下当前Loss的情况

if batch_id % 200 == 0:

print("epoch: {}, batch: {}, loss is: {}".format(epoch_id, batch_id, avg_loss.numpy()))

#后向传播,更新参数的过程

avg_loss.backward()

optimizer.minimize(avg_loss)

model.clear_gradients()

#保存模型参数

fluid.save_dygraph(model.state_dict(), 'mnist')把它改写成pytorch版本也很简单,毕竟数据读取的函数与用什么深度学习框架没有什么关系

还是要注意pytorch的好几个函数名都不一样

# 数据处理部分之后的代码,数据读取的部分调用load_data函数

# 定义网络结构,同上一节所使用的网络结构

class Mnist(nn.Module):

def __init__(self):

super(Mnist,self).__init__()

self.fc1 = nn.Linear(28*28*1,1)

def forward(self,x):

x = x.view(-1,28*28*1)

x = self.fc1(x)

return x

# 训练配置,并启动训练过程

model = Mnist()

model.train(mode=True)

#调用加载数据的函数

train_loader = load_data('train')

optimizer = optim.SGD(model.parameters(),lr= 0.001)

criterion = nn.MSELoss()

EPOCH_NUM = 10

for epoch_id in range(EPOCH_NUM):

for batch_id, data in enumerate(train_loader()):

#准备数据,变得更加简洁

image_data, label_data = data

image = torch.tensor(image_data)

label = torch.tensor(label_data)

#前向计算的过程

predict = model(image)

#计算损失,取一个批次样本损失的平均值

loss = criterion(predict, label)

avg_loss = torch.mean(loss)

#每训练了200批次的数据,打印下当前Loss的情况

if batch_id % 200 == 0:

print("epoch: {}, batch: {}, loss is: {}".format(epoch_id, batch_id, avg_loss.detach().numpy()))

#后向传播,更新参数的过程

avg_loss.backward()

optimizer.step()

model.zero_grad()之后教程还说了paddle怎么异步读取,这个之后再说吧

话说今天lycoris更新了,真的好甜啊

Comments NOTHING